在当今互联网时代,大型网站面临着海量用户访问、高并发请求以及业务连续性的严峻挑战。负载均衡架构,作为应对这些挑战的核心技术方案,已成为构建健壮、可扩展和高性能网站不可或缺的基石。它通过合理分配网络流量,确保系统资源的有效利用,从而保障用户体验的流畅与稳定。

一、负载均衡的核心价值与目标

负载均衡的核心目标在于提升系统整体性能、增强可用性、实现水平扩展。具体而言:

- 性能优化:将用户请求智能地分发到后端多台服务器,避免单点过载,缩短响应时间,提升吞吐量。

- 高可用保障:通过健康检查机制,自动屏蔽故障节点,将流量导向健康的服务器,确保服务不中断。

- 弹性伸缩:在流量高峰时,可以方便地添加服务器以分担压力;在低谷时,亦可缩减资源以节省成本,实现资源的动态管理。

二、主流负载均衡技术架构

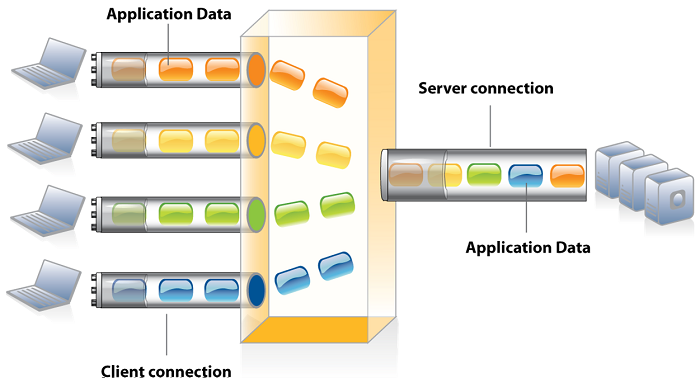

负载均衡的实现通常涉及多个层次,形成一个立体的架构体系。

1. DNS负载均衡

这是最基础的负载均衡方式,通过在DNS服务器中为一个域名配置多个A记录(IP地址),将用户访问随机或按策略导向不同的数据中心或入口IP。其实现简单,但粒度较粗,且DNS缓存可能影响调度的实时性,常用于第一层的全局流量引导。

2. 硬件负载均衡

采用专用的硬件设备(如F5、A10等),性能强大、功能丰富(如SSL加速、深度流量分析),能够处理极高的并发连接。它通常部署在网络入口,作为四层(传输层)和七层(应用层)负载均衡的核心。硬件方案稳定可靠,但成本高昂,扩展性相对受限。

3. 软件负载均衡

基于通用服务器和软件实现,是目前互联网公司的主流选择,具有极高的灵活性和成本效益。代表产品有:

- 四层负载均衡:如LVS(Linux Virtual Server)。它在操作系统内核空间工作,仅根据IP和端口进行转发,性能极高,常用于数据库、缓存等服务的负载。

- 七层负载均衡:如Nginx、HAProxy。它们在用户空间工作,能够解析HTTP/HTTPS等应用层协议,可以根据URL、请求头、Cookie等丰富的信息进行精细化的流量路由。Nginx因其高性能、高并发和模块化设计,尤其擅长处理静态资源和反向代理,是Web层负载的绝对主力。

4. 云服务商负载均衡器

公有云平台(如AWS ALB/ELB、阿里云SLB、腾讯云CLB)提供了全托管的负载均衡服务。它们天然集成了云环境的弹性伸缩、安全防护和监控告警能力,无需运维硬件或软件,是实现快速部署和运维自动化的理想选择。

三、典型的负载均衡分层架构

一个成熟的大型网站负载均衡架构往往是多层次的。一个经典的“四层+七层”组合架构示例如下:

- 第一层:DNS与全局负载均衡(GSLB):实现跨地域、多机房的流量调度与容灾。

- 第二层:四层负载均衡(LVS集群):位于每个机房入口,接收来自GSLB或直接的用户流量,进行TCP/UDP级别的快速分发,将请求转发给后端的七层负载均衡器集群。LVS本身通过主备或集群方式保证高可用。

- 第三层:七层负载均衡(Nginx集群):接收来自LVS的流量,进行HTTP协议解析,根据具体的业务规则(如域名、路径、会话)将请求路由到对应的应用服务器集群。Nginx也承担着静态文件缓存、SSL终结、限流等重要功能。

- 后端服务层:包括Web应用服务器、微服务、数据库、缓存、消息队列等。负载均衡的理念可以进一步深入到这些服务内部,通过客户端SDK或服务网格实现更细粒度的服务间调用负载均衡。

四、关键策略与考量

- 调度算法:选择合适的算法至关重要,常见的有轮询、加权轮询、最少连接、源IP哈希(用于会话保持)、一致性哈希(用于缓存场景)等。

- 会话保持:对于有状态的应用,需要通过Cookie插入、IP绑定等机制确保同一用户的请求落在同一后端服务器上。

- 健康检查:动态感知后端服务器状态是保障高可用的关键,包括TCP端口检查、HTTP请求检查等。

- 容灾与高可用:负载均衡器自身不能成为单点故障,需通过主备、双活或多活集群部署,结合虚拟IP(VIP)和心跳检测实现故障自动转移。

- 安全与监控:负载均衡层是实施DDoS防御、WAF(Web应用防火墙)的绝佳位置。完善的监控体系(流量、连接数、响应时间、后端健康状态)是运维的眼睛。

五、与展望

负载均衡架构是大型网站技术体系的“交通枢纽”和“压力缓冲器”。从硬件的集中式处理到软件的分布式部署,再到云原生的全托管服务,其形态不断演进。随着微服务、容器化(如Kubernetes Service)和云原生技术的普及,负载均衡正变得更加智能化、自动化和服务网格化。它将继续与弹性计算、服务发现、API网关等技术深度融合,为构建更加 resilient(韧性)、 scalable(可扩展)的下一代互联网应用提供核心支撑。

本文由火龙果软件工程整理并提供,旨在分享软件架构知识。负载均衡架构设计需结合实际业务流量、技术栈和运维能力进行具体决策。